从Google与Anthropic看2025 Agent势不可挡的爆发——AI时代的入口

01

阅读了几篇系统讨论AI Agent的文章,选了2篇(来自Google与Anthropic)来思考探讨。

本文分别简要讨论这两篇(在03、04展开),并融合我的个人思考。

我们去看一看真正的AI时代——AI Agent(我更倾向于叫做智能体而非AI代理)

02

毫无疑问我们都认为下一个风口是AI。

在经历了过去两年生成式AI的发展后,AI Agent正在成为行业新的焦点。

虽然基础模型仍在持续演进,但不少创业公司在这场烧钱竞赛中被巨头们收购,业界也已对AI领域“模型与应用并重”的高成本特征达成共识。

从2024年初AI Agent概念广泛传播,到下半年许多AI应用的出圈(如NotebookLM、Cursor、HeyGen等),再到12月中旬500美元一个月的Devin的全面开放标志着“第一个真正意义上“的智能体诞生,大模型的重要性毋庸置疑,但似乎它的作用地位在不断被抽象和封装,逐渐成为一个基础设施。

互联网时代有操作系统和浏览器等构建起了我们的网络生态。如今,聊天机器人的产品形态从来没有被认为是AI的最终形态。

那么智能体会是AI时代的一个入口吗?

目前,各方都看好2025 AI Agent的全面爆发。

03

Google的白皮书:智能体的架构与核心逻辑

1 | 来自谷歌在九月份发布的名为“Agents”的42页白皮书,最近在X和领英上被熟知:https://media.licdn.com/dms/document/media/v2/D561FAQH8tt1cvunj0w/feedshare-document-pdf-analyzed/B56ZQq.TtsG8AY-/0/1735887787265?e=1736985600&v=beta&t=pLuArcKyUcxE9B1Her1QWfMHF_UxZL9Q-Y0JTDuSn38 |

如果你还不太了解AI Agents,这篇论文值得精读。

智能体不仅是更智能的模型——

谷歌强调了智能体的自主性,着重定义了”独立于人类干预进行行动“。实际上,我认为这一点尤其重要。

之所以认为AI是新时代的一个重要因素是普遍认可它能够提高生产力,这一点是前几次工业革命的相同点。

谷歌认为,AI Agent与传统LLM有区别,尽管他们本质上还是基于大模型,但LLM局限于从训练数据中学到过时的内容,而且只能解决表面的问题(或者说是形而上的)。相比之下,智能体能够与外部进行交互并真正地执行任务,影响现实。

“在传统模型中,知识仅限于其训练数据中可用的内容,”论文指出。“通过工具与外部系统的连接,智能体扩展了这种知识。”

我简单举个例子。当语言模型成为一个厨师,它只会教导如何做菜;而智能体呢?毫无疑问,他会做出饭来,他能够自主决策并去执行。

我们看到了智能体将带来的变化,他能够根据任务通过整合推理和执行以达成目标,他可能成为一种数字工作者,处理复杂的流程,Devin就是如此。

智能体拥有强大的执行逻辑——

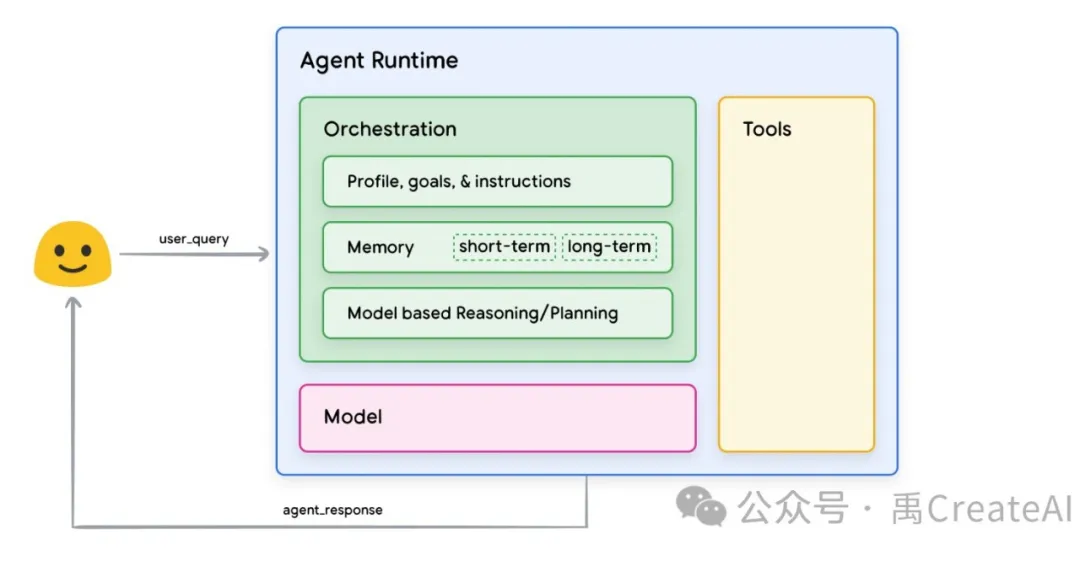

实际上,智能体的核心并不简单是LLM,而是基于此构建出的”编排层“架构,其中包含了推理、规划和决策。这个架构允许智能体在执行中更新信息,完善后再去执行,不断迭代。

智能体也可以使用工具与RAG——

现在,很多chatbot都增加了很多功能包括搜索等,而智能体毫无疑问同样可以通过调取API整合复杂的逻辑。甚至,他可以自己决策调用什么,如何去调用,因为他自己可以去访问网站,只要他被允许这么做,你可以在Devin中看到。

RAG(检索增强生成)允许智能体在数据不足的情况下查询外部数据源,可以是你自己的文档、知识库等,你需要将其结构化或向量化。

推理模型——

论文中没有提到的一点,但我认为将会变成促进智能体发展很重要的一点:推理模型。

由于白皮书是在9月份发布的,而o1与o3都在后续发布。o3的能力已经超过绝大部分人类,只要成本打下来,绝对极大推动智能体的发展。期待中国公司的努力。

为什么这么说,因为推理的进步本身就可以极大优化谷歌提到的”编排层“架构,包含推理、规划和决策。

论文中同样提到了一些Agent构建框架的使用,就不具体展开了。

04

Anthropic:如何构建有效的智能体

1 | 来自Anthropic的“Building effective agents”:https://www.anthropic.com/research/building-effective-agents |

这篇文章并不长且干货很多,建议全文精读。

一直都很喜欢Anthropic的网站风格,包括他们的文章。(难道是因为被Claude夸吗?最近关于Claude附和用户的吐槽很多)

这一篇文章的主题就如标题一般“构建有效的智能体(代理)”,更加侧重于实践。

严谨的定义——

在这篇文章中,Anthropic给出了一个对于Agents很客观全面的定义(Agent被翻译为代理):

代理开始工作,要么是来自人类用户的命令,要么是与人类用户的交互式讨论。一旦任务明确,代理将独立规划和操作,可能需要返回人类用户以获取更多信息或判断。在执行过程中,代理在每一步都需要从环境中获取“事实真相”(例如工具调用结果或代码执行)以评估其进度。代理可以在检查点或遇到阻碍时暂停以获取人类反馈。任务通常在完成时终止,但也可以包括停止条件(例如最大迭代次数)以保持控制。

简化优先——

Anthropic提出了大多数情况下复杂的Agent是不需要的,解决我们的需求的成功在于构建符合需求的系统,而非单纯追求复杂性,他们强调了复杂是需要牺牲延迟和成本的。

因此,他们将代理系统分为了增强型LLM、工作流和智能体。这甚至是一个循序渐进的过程。作者指出:

在构建带有LLMs的应用程序时,我们建议寻找尽可能简单的解决方案,并在必要时才增加复杂性。这可能意味着根本不构建代理系统。

这倒是为我提供很好的参考意见。

“代理的自主性意味着更高的成本,以及累积错误的潜在可能性。”作者强调了这一点,与Google的观点还是有不同的,倒也符合Anthropic从安全出发的态度。

文章展示了5种工作流模式,简单而高效,如果你想要构建一些流程的话,建议阅读。

05

未来

读到这里,不知你有没有构建过智能体,从你的需求或者创意出发。

我在之前的文章也分享过我在构建智能体的一些想法与实践,不过他们并不是Google所指出的自主性的Agent,更像是Anthropic的增强型LLM,但这也足够解决我的需求了。

如果你还没有去实践过,那就要抓紧了。

等自主性的Agent可以被个人构建出来时,AI时代的入口大概就要来临了,那可能就是”iphone4时刻”。

来自AI总结:

1.Agent兴起

生成式AI推动了智能体的发展,AI大模型逐渐成为基础设施。2025年被看好为AI智能体全面爆发的关键年份,它可能成为AI时代的重要入口。

2.Google白皮书

强调智能体的自主性,它不仅是大模型的延伸,还能规划、决策和执行任务,与外部交互。智能体通过编排层架构和工具调用,解决实际问题并不断迭代优化。

3.Anthropic实践指南

提倡构建简单、高效的智能体。智能体自主性虽重要,但复杂性带来高成本和累积错误风险。建议逐步增加复杂性,构建适合需求的解决方案。

4.未来展望

智能体的发展将打开AI新时代的入口,个人构建自主智能体或成趋势。抓住机遇,实践是关键。